Les pionniers de la technologie aux États-Unis préconisent une nouvelle approche de la gouvernance basée sur les données – « La réglementation algorithmique ». Mais si la technologie apporte des réponses aux problèmes de société, quel impact pour les gouvernements ?

Le 24 août 1965 Gloria Placente, une résidente de 34 ans du Queens, New York, roulait vers Orchard Beach dans le Bronx. Vêtue d’un short et de lunettes de soleil, cette maîtresse de maison était impatiente de passer quelques heures tranquilles à la plage. Mais au moment où elle a traversé le pont Willis Avenue dans sa Chevrolet Corvair, Placente a été entourée par une douzaine de patrouilleurs. Il y avait aussi 125 journalistes, avides d’assister au lancement de l’opération CORRAL de la police de New York – un acronyme signifiant Computer Oriented Retrieval of Auto Larcenists, soit « recherche assistée par ordinateurs de voleurs de voitures ».

Quinze mois plus tôt, Placente avait brûlé un feu rouge et négligé de répondre à la citation à comparaître, une infraction que CORRAL allait punir avec une forte dose techno-kafkaïenne.

Quinze mois plus tôt, Placente avait brûlé un feu rouge et négligé de répondre à la citation à comparaître, une infraction que CORRAL allait punir avec une forte dose techno-kafkaïenne.

CORRAL travaille comme suit : une voiture de police stationnée à une extrémité du pont communique par radio les plaques des voitures venant en sens inverse à un opérateur à distance, qui les introduit dans un ordinateur Univac 490, un jouet cher – $ 500,000 (3,5 millions $ en dollars d’aujourd’hui) prêté par la Sperry Rand Corporation. L’ordinateur compare les numéros avec ceux d’une base de données de 110 000 voitures qui ont été soit volées soit ayant appartenu à des délinquants connus. Dans le cas d’identification, l’opérateur alerte une seconde voiture de patrouille à l’autre sortie du pont. L’opération prend, en moyenne, seulement sept secondes.

Par rapport à la vitesse impressionnante des outils de la police d’aujourd’hui – la reconnaissance automatique de plaques d’immatriculation, les caméras de vidéosurveillance, les pisteurs GPS, l’opération CORRAL semble un rien démodée vu les possibilités de contrôle en développement. Les responsables européens ont même envisagé d’exiger que tous les véhicules entrant sur le marché européen disposent d’un mécanisme intégré qui permette à la police d’arrêter les véhicules à distance.

S’exprimant sur ce sujet, Jim Farley, un haut dirigeant de Ford, a reconnu que « Nous savons tous qui enfreint la loi, nous savons quand vous le faites. Nous avons un GPS dans votre voiture, nous savons donc ce que vous faites. Au fait, nous ne fournissons pas les données à n’importe qui. ». Ces affirmations ne sonnant pas très rassurantes, Farley est revenu sur ses propos.

Comme les voitures et les routes deviennent « intelligentes », elles comportent la promesse d’une application presque parfaite de la loi en temps réel. Au lieu d’attendre que les conducteurs enfreignent la loi, les autorités peuvent tout simplement empêcher le crime. Ainsi, un tronçon de 50 miles de l’A14 entre Felixstowe et Rugby (Royaume-Uni) doit être équipé de nombreux capteurs qui surveillent la circulation en envoyant des signaux vers et à partir des téléphones mobiles dans les véhicules en mouvement. Le régulateur des télécommunications Ofcom prévoit que les routes intelligentes connectées à un système de circulation centralisé pourraient imposer automatiquement des limites de vitesse variables pour lisser le flux du trafic, mais aussi pour diriger les voitures « le long des itinéraires déviés pour éviter les bouchons et même [gérer] leur vitesse ».

Autres gadgets – des smartphones à lunettes intelligentes – promettent encore plus de sûreté et de sécurité. En Avril, Apple a breveté une technologie qui active des capteurs à l’intérieur du smartphone pour analyser si la voiture est en mouvement et si la personne qui utilise le téléphone est au volant ; si les deux conditions sont remplies, il bloque tout simplement les fonctionnalités de SMS du téléphone.

Intel et Ford travaillent sur le projet Mobil – un système de reconnaissance facial qui, s’il ne reconnaît pas le visage du conducteur, non seulement empêche la voiture de démarrer, mais aussi envoie la photo au propriétaire de la voiture (une mauvaise nouvelle pour les adolescents).

La voiture est emblématique des transformations dans de nombreux autres domaines. Des environnements intelligents appelés « Ambient Assisted Living » où les tapis et murs sont capables de détecter que quelqu’un est tombé, à différents schémas directeurs de « ville intelligente », où les services municipaux envoient des ressources uniquement aux zones qui en ont besoin.

Grâce aux capteurs et à Internet, les objets du quotidien les plus banals ont acquis un pouvoir énorme de réglementation de notre comportement. Même les toilettes publiques sont mûres pour l’optimisation à base de capteurs : « Safeguard Germ Alarm » est un distributeur de savon intelligent développé par Procter & Gamble et utilisé dans certaines toilettes publiques aux Philippines : il possède des capteurs de surveillance des portes de chaque toilette. Une fois que vous quittez la toilette, l’alarme se met à sonner – et ne peut être arrêtée que par une simple pression sur le bouton distributeur de savon.

Grâce aux capteurs et à Internet, les objets du quotidien les plus banals ont acquis un pouvoir énorme de réglementation de notre comportement. Même les toilettes publiques sont mûres pour l’optimisation à base de capteurs : « Safeguard Germ Alarm » est un distributeur de savon intelligent développé par Procter & Gamble et utilisé dans certaines toilettes publiques aux Philippines : il possède des capteurs de surveillance des portes de chaque toilette. Une fois que vous quittez la toilette, l’alarme se met à sonner – et ne peut être arrêtée que par une simple pression sur le bouton distributeur de savon.

Dans ce contexte, le dernier plan de Google pour pousser son système d’exploitation Android sur les montres intelligentes, les voitures intelligentes, et les thermostats intelligents, on l’aura compris tout ce qui peut recevoir le qualificatif « intelligent », semble plutôt inquiétant. Ainsi dans un avenir proche, Google sera l’intermédiaire entre vous et votre réfrigérateur, vous et votre voiture, vous et votre poubelle, permettra aux Agences nationales de sécurité de s’acquitter de leur addiction aux données en vrac et via un point d’accès unique.

Cette « smartification » de la vie quotidienne suit un schéma familier : on y trouvera des données primaires – une liste de ce qui est dans votre réfrigérateur intelligent et votre poubelle – et leurs métadonnées (données sur les données) – un journal vous dira combien de fois vous avez ouvert l’un ou l’autre de ces objets – quand ils communiquent entre eux. Cela peut parfois produire des idées intéressantes : comme par exemple les matelas intelligents – un modèle récent permet de suivre la respiration et le rythme cardiaque et enregistrer tous vous mouvements pendant la nuit – les ustensiles intelligents qui fournissent des conseils nutritionnels.

Cette « smartification » de la vie quotidienne suit un schéma familier : on y trouvera des données primaires – une liste de ce qui est dans votre réfrigérateur intelligent et votre poubelle – et leurs métadonnées (données sur les données) – un journal vous dira combien de fois vous avez ouvert l’un ou l’autre de ces objets – quand ils communiquent entre eux. Cela peut parfois produire des idées intéressantes : comme par exemple les matelas intelligents – un modèle récent permet de suivre la respiration et le rythme cardiaque et enregistrer tous vous mouvements pendant la nuit – les ustensiles intelligents qui fournissent des conseils nutritionnels.

En plus de rendre nos vies plus efficaces, ce monde intelligent nous met devant un choix politique intéressant. Si tant d’éléments de notre comportement quotidien sont déjà capturés, analysés, pourquoi s’en tenir à des approches non-empiriques de la réglementation ? Pourquoi s’appuyer sur les lois quand on a des capteurs et des mécanismes de rétroaction ? Si les interventions politiques doivent être – pour utiliser les mots à la mode du jour – « factuelles » et « axées sur les résultats », la technologie n’est-elle pas là pour nous aider?

Ce nouveau type de gouvernance a un nom : la réglementation algorithmique. Dans la mesure où la Silicon Valley a un programme politique, c’est bien celui-ci. Tim O’Reilly, un éditeur influent, un capital-risqueur et un homme d’idées (c’est lui qui a popularisé le terme « web 2.0 ») en est le promoteur le plus enthousiaste. Dans un essai récent ou il explique son raisonnement, O’Reilly analyse les vertus supposées de la « réglementation algorithmique » – il fait un examen approfondi à la fois de ce qu’elle peut offrir aux décideurs et présente ses hypothèses simplistes de la politique, de la démocratie et de l’autorité.

Pour imaginer comment la réglementation algorithmique pourrait fonctionner, ne cherchez pas plus loin que le filtre anti-spam de votre boîte email. Au lieu de se limiter à une définition étroite du spam, le filtre de messagerie apprend de ses utilisateurs. Même Google est incapable d’écrire des règles pour couvrir toutes les innovations ingénieuses de spammeurs. Ce qu’il peut faire, cependant, c’est enseigner au système ce qui fait une bonne règle et comment repérer quand il est temps d’en trouver une autre – et ainsi de suite. Un algorithme peut le faire, mais c’est la rétroaction (le retour d’expérience) en temps réel des utilisateurs qui permet au système de contrer des menaces qui n’ont pas été envisagées par les concepteurs. Et il ne s’agit pas que du spam : votre banque utilise des méthodes similaires pour repérer la fraude de carte de crédit.

Dans son essai, O’Reilly tire de larges enseignements philosophiques de ces technologies, en faisant valoir que cela fonctionne parce qu’elles reposent sur « une connaissance approfondie du résultat souhaité » (spam est mauvais !) Et de vérifier périodiquement si les algorithmes travaillent effectivement comme prévu (de trop nombreux courriels légitimes ne se retrouvent-ils pas marqués comme spam ?).

Dans son essai, O’Reilly tire de larges enseignements philosophiques de ces technologies, en faisant valoir que cela fonctionne parce qu’elles reposent sur « une connaissance approfondie du résultat souhaité » (spam est mauvais !) Et de vérifier périodiquement si les algorithmes travaillent effectivement comme prévu (de trop nombreux courriels légitimes ne se retrouvent-ils pas marqués comme spam ?).

O’Reilly présente ces technologies comme innovantes et uniques – après tout nous vivons une révolution numérique – mais le principe qui sous-tend la « réglementation algorithmique » semblerait familier aux fondateurs de la cybernétique – une discipline dont le nom (qui étymologiquement signifie « la science de la gouvernance ») signale les hautes ambitions réglementaires. Le principe, qui permet au système de maintenir sa stabilité en apprenant constamment et en s’adaptant à l’évolution des situations, c’est ce que le psychiatre britannique Ross Ashby, l’un des pères fondateurs de la cybernétique, appela « ultra-stabilité ».

Pour l’illustrer, Ashby a conçu l’homéostat, un dispositif intelligent composé de quatre unités interconnectées de contrôle de bombes de la RAF – de mystérieuses boîtes noires avec beaucoup de boutons et de commutateurs sensibles aux fluctuations de tension. Si une unité cesse de fonctionner correctement – par exemple, en raison d’une perturbation externe inattendue – les trois autres sauraient se recâbler et se regrouper pour compenser le mauvais fonctionnement de façon à maintenir stable la production globale du système.

Pour l’illustrer, Ashby a conçu l’homéostat, un dispositif intelligent composé de quatre unités interconnectées de contrôle de bombes de la RAF – de mystérieuses boîtes noires avec beaucoup de boutons et de commutateurs sensibles aux fluctuations de tension. Si une unité cesse de fonctionner correctement – par exemple, en raison d’une perturbation externe inattendue – les trois autres sauraient se recâbler et se regrouper pour compenser le mauvais fonctionnement de façon à maintenir stable la production globale du système.

L’homéostat d’Ashby atteint « l’ultra-stabilité » en surveillant toujours son état interne et en redéployant intelligemment ses ressources en réserve.

Comme dans le cas du filtre de spam, il n’est pas nécessaire de spécifier toutes les perturbations possibles – pas plus que les conditions de comment et quand il doit être mis à jour et remodelé. Ce n’est pas une simple évolution de la façon dont les systèmes techniques habituels fonctionnent, avec leurs règles rigides, (les règles IF… THEN…).Il n’est soudain plus nécessaire d’élaborer des procédures pour gérer toutes les éventualités. On espère donc que les algorithmes munis d’une rétroaction en temps réel peuvent faire un meilleur travail que des règles inflexibles en inévitable décalage avec la réalité.

La réglementation algorithmique pourrait certainement rendre l’application des lois existantes plus efficaces. Si l’on peut lutter contre la fraude de carte de crédit, pourquoi pas la fraude fiscale ? Les fonctionnaires de l’administration italienne ont expérimenté le Redditometro, ou mesure du revenu, un outil qui permet de comparer les habitudes de dépenses des gens – enregistrées grâce à une vieille loi italienne – avec leurs revenus déclarés, afin que les autorités sachent quand vous dépensez plus que vous ne gagnez. L’Espagne a exprimé son intérêt pour un outil similaire.

La réglementation algorithmique pourrait certainement rendre l’application des lois existantes plus efficaces. Si l’on peut lutter contre la fraude de carte de crédit, pourquoi pas la fraude fiscale ? Les fonctionnaires de l’administration italienne ont expérimenté le Redditometro, ou mesure du revenu, un outil qui permet de comparer les habitudes de dépenses des gens – enregistrées grâce à une vieille loi italienne – avec leurs revenus déclarés, afin que les autorités sachent quand vous dépensez plus que vous ne gagnez. L’Espagne a exprimé son intérêt pour un outil similaire.

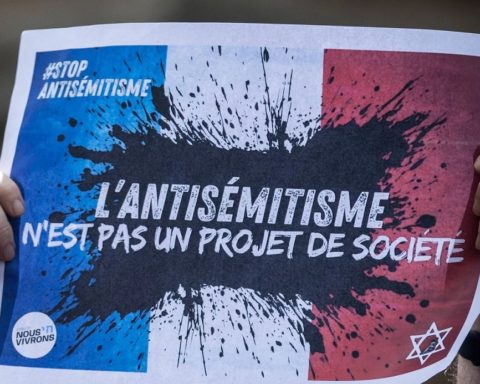

Ces systèmes sont cependant impuissants face aux vrais coupables de fraude fiscale – les familles super-riches qui profitent de différents régimes, de la délocalisation ou tout simplement font inscrire des exonérations fiscales scandaleuses dans la loi. La réglementation algorithmique est parfaite pour faire respecter l’austérité à l’ordre du jour tout en laissant les responsables de la crise financière non inquiétés. Pour comprendre si ces systèmes fonctionnent comme prévu, nous devons modifier la question de O’Reilly : pour qui travaillent-ils ? Si c’est juste pour que les ploutocrates puissent éluder l’impôt, pour les institutions financières internationales intéressées dans les budgets nationaux équilibrés et pour les entreprises qui développent des logiciels de suivi de revenu, alors ce ne sera pas vraiment un succès démocratique.

Porté par sa conviction que la réglementation algorithmique est basée sur « une connaissance approfondie des résultats escomptés », O’Reilly déconnecte habilement les moyens de faire de la politique des objectifs politiques. Mais la mise en œuvre d’une politique est aussi importante que la politique elle-même – en fait, l’une façonne souvent l’autre. Tout le monde est d’accord que l’éducation, la santé et la sécurité sont tous des « résultats souhaités », mais comment les atteindre ?

Dans le passé, lorsque nous avons été confronté au choix politique difficile de les délivrer soit par le marché soit par l’État, les lignes du débat idéologique étaient claires. Aujourd’hui, lorsque le choix qui se pose est entre le numérique et l’analogique ou entre une approche dynamique (avec prise en compte régulière des retours d’information) ou statique de la loi, la clarté idéologique a disparu. Comme si le choix même de la façon de réaliser ces « résultats souhaités » était apolitique et qu’on n’était pas forcé de choisir entre des visions différentes et souvent incompatibles de la vie en commun.

En supposant que le monde utopique des boucles de rétroaction infinies devienne si efficace qu’il transcende la politique, les partisans de la réglementation algorithmique tombent dans le même piège que les technocrates du passé. Oui, ces systèmes sont terriblement efficaces – de la même manière que Singapour est terriblement efficace (O’Reilly, sans surprise, fait l’éloge de Singapour pour son adoption de la réglementation algorithmique). Et tandis que les dirigeants de Singapour pourraient croire que, eux aussi, ils ont transcendé la politique, cela ne signifie pas que leur régime ne peut pas être évalué à l’extérieur du discours de l’efficacité et de l’innovation en utilisant des critères politiques plutôt qu’économiques.

Comme la Silicon Valley ne cesse de corrompre notre langue avec sa glorification sans fin de percées technologiques et d’efficacité – concepts en contradiction avec le vocabulaire de la démocratie – notre capacité à remettre en question le « comment » de la politique se retrouve affaiblie. La réponse par défaut de la Silicon Valley à ce qu’est la politique est ce que j’appelle le « solutionnisme »: les problèmes doivent être traités via des applications, des capteurs, et des boucles de rétroaction – tous fournis par les startups. Plus tôt cette année, Eric Schmidt de Google a même promis que les startups seraient la solution au problème de l’inégalité économique : celle-ci, semble-t-il, peut également être « perturbée » donc susceptible d’innovation. Les innovateurs montrent le chemin, les fonctionnaires suivent.

Les services de renseignement ont adopté le « solutionnisme » avant d’autres organismes gouvernementaux. Ainsi, ils ont réduit le thème du terrorisme d’un sujet qui a un lien avec l’histoire et la politique étrangère à un problème d’information de l’identification des menaces terroristes émergentes via une surveillance constante. Ils ont exhorté les citoyens à accepter que l’instabilité soit la règle du jeu, que ses causes profondes ne sont ni traçables ni réparables, que la menace ne peut être prévenue que par une sur-innovation et une hyper-surveillance des ennemis en améliorant la communication.

S’exprimant à Athènes en novembre dernier, le philosophe italien Giorgio Agamben a évoqué le changement de paradigme dans la notion de gouvernement « qui veut que la relation hiérarchique traditionnelle entre causes et effets soit inversée, de sorte que, au lieu de gouverner les causes – une entreprise difficile et coûteuse – les gouvernements tentent simplement de contrôler les effets ».

Pour Agamben, ce changement est emblématique de la modernité. Cela explique aussi pourquoi la libéralisation de l’économie peut coexister avec la prolifération croissante du contrôle dans la vie quotidienne – par le biais de distributeurs de savon et de voitures gérées à distance. « Si le gouvernement vise les effets et non les causes, il sera tenu d’étendre et multiplier les contrôles. Identifier les causes demande de l’analyse de la connaissance, tandis que les effets peuvent être vérifiés et contrôlés. » La réglementation algorithmique est la mise un œuvre d’un programme politique par le biais technologique.

Les vraies politiques de régulation algorithmique deviennent visibles une fois que sa logique est appliquée aux protections sociales de l’État-providence. Ce n’est pas un appel pour les démanteler, mais les citoyens sont néanmoins encouragés à prendre en charge leur propre santé. Voyez comment Fred Wilson, un influent capital-risqueur américain, encadre le sujet. « La santé est … l’opposé des soins de santé, » a-t-il dit lors d’une conférence à Paris en décembre dernier. « C’est ce qui vous garde du système de soins de santé en premier lieu. » Ainsi, nous sommes invités à commencer à utiliser les applications d’auto-suivi et de partage des données, de surveiller nos indicateurs vitaux, nos symptômes et les lacunes de notre propre santé.

Cela est bien en accord avec les propositions récentes pour sauver les services publics en difficulté en favorisant des modes de vie plus sains. Ainsi le rapport 2013 de l’Unité d’information du gouvernement local du Conseil de Westminster et, un groupe de réflexion appellent à la subordination des prestations de logement et autres prestations sociales à des visites des demandeurs à la salle de gym – avec l’aide de cartes à puce. Ces cartes à puce pourraient ne pas être nécessaires : de nombreux smartphones peuvent déjà compter les pas que nous faisons chaque jour (Google Now, assistant virtuel de l’entreprise, fait le relevé de ces données automatiquement et il présente périodiquement les résultats aux utilisateurs, les poussant à marcher plus).

Les nombreuses possibilités que les dispositifs de suivi offrent aux industries de la santé et d’assurance ne sont pas perdues pour O’Reilly. « Vous saviez que la publicité s’est avérée être le modèle d’affaires de base pour l’Internet ? » Lors d’une conférence récente, il se demandait : « Je pense que l’assurance va être le modèle d’affaires d’origine pour l’Internet des choses ».

Les choses semblent se diriger dans cette voie : en juin, Microsoft a conclu un accord avec American Family Insurance, le huitième plus grand assureur du logement aux États-Unis, dans lequel les deux sociétés vont financer les startups qui veulent mettre des capteurs dans les maisons intelligentes et les voitures intelligentes aux fins de « protection proactive ».

Une compagnie d’assurance serait heureuse de subventionner les coûts d’installation de capteurs dans votre maison – aussi longtemps qu’elle pourra automatiquement alerter les pompiers ou faire que les lumières du porche sur la rue clignotent au cas où votre détecteur de fumée se déclenche. Pour l’instant, accepter de tels systèmes de suivi est présenté comme un avantage supplémentaire qui peut nous épargner de l’argent. Mais quand en arriverons-nous au point où ne pas les utiliser sera considéré comme une négligence – ou, pire, un acte de dissimulation – qui doit être pénalisé par des primes plus élevées ?

Une compagnie d’assurance serait heureuse de subventionner les coûts d’installation de capteurs dans votre maison – aussi longtemps qu’elle pourra automatiquement alerter les pompiers ou faire que les lumières du porche sur la rue clignotent au cas où votre détecteur de fumée se déclenche. Pour l’instant, accepter de tels systèmes de suivi est présenté comme un avantage supplémentaire qui peut nous épargner de l’argent. Mais quand en arriverons-nous au point où ne pas les utiliser sera considéré comme une négligence – ou, pire, un acte de dissimulation – qui doit être pénalisé par des primes plus élevées ?

Dans son rapport de mai 2014 de 2020Heath, un autre groupe de réflexion propose des allègements fiscaux aux Britanniques qui arrêtent de fumer, restent minces ou boivent moins : « Nous proposons le « paiement par résultats », une récompense financière pour les personnes qui deviennent des partenaires actifs dans la santé, dans lequel si vous promettez, par exemple, de maintenir bas votre taux de sucre dans le sang, arrêtez de fumer, perdez du poids, [ou] prenez davantage soin de vous-même, il y aura réduction d’impôt ou prime de fin d’année ».

Les gadgets intelligents sont les alliés naturels de ces politiques : ils documentent les résultats et peuvent même aider à les atteindre – en ne cessant de nous harceler à faire ce qui est attendu de nous.

L’hypothèse sous-jacente de la plupart de ces rapports est que la mauvaise santé n’est pas seulement un fardeau pour la société mais mérite d’être punie (fiscalement pour l’instant) pour irresponsabilité. Qu’est-ce qui pourrait expliquer leurs problèmes de santé, sinon leurs déficiences personnelles ? Ce n’est en tout cas pas l’emprise des entreprises alimentaires ni les différences fondées sur la classe sociale ou les diverses injustices politiques et économiques. On pourra bien porter une douzaine de capteurs puissants, posséder un matelas intelligent, ce genre d’injustices restera inaperçu, car elles ne sont pas le genre de choses qui peuvent être mesurées par un capteur. Suivre à la trace les injustices sociales est beaucoup plus difficile que la vie quotidienne des personnes dont les vies qui en pâtissent.

En déplaçant l’attention des insuffisances institutionnelles et des malversations économiques pour s’attacher au contrôle des personnes, la réglementation algorithmique nous offre une bonne vieille utopie technocratique de la politique sans politique. Le désaccord et le conflit, selon ce modèle, sont considérés comme des sous-produits malheureux de l’ère analogique – à résoudre par la collecte des données – et non comme les conséquences inévitables de conflits économiques ou idéologiques.

Cependant, une politique sans politique ne signifie pas une politique sans contrôle ni administration. Comme O’Reilly l’écrit dans son essai : « Les nouvelles technologies permettent de réduire le coût de la réglementation tout en augmentant la quantité de surveillance et de production de résultats souhaitables. »

Ainsi, c’est une erreur de penser que la Silicon Valley veut nous débarrasser des institutions gouvernementales. Son rêve n’est pas un petit gouvernement de libertaires – un petit État, après tout, n’a besoin ni de gadgets sophistiqués ni de serveurs massifs pour traiter les données – mais bien les économistes comportementaux obsédés par le besoin de données.

Ceux qui sont amoureux de la technologie, le sont pour son principe fondateur essentiel qui est que, tandis que nous nous comportons de façon irrationnelle, notre irrationalité peut être corrigée – si l’environnement agit sur nous en nous poussant vers la bonne option.

Sans surprise, l’une des trois références à la fin de l’essai de O’Reilly pointe sur un discours prononcé en 2012 « Regulation: Looking Backward, Looking Forward » by Cass Sunstein, un juriste américain de premier plan qui est le principal théoricien de ce type de gouvernance. Et tandis que ses partisans ont déjà séduit l’État en faisant de la psychologie comportementale le discours favori de la bureaucratie gouvernementale – Daniel Kahneman est à la mode, Machiavel est ringard – le lobby de la régulation algorithmique avance de façon plus clandestine.

Ils créent des organisations à but non lucratif inoffensives comme « Code for America » qui a ensuite enrôlé l’État – sous le couvert d’encourager des hackers de talent à résoudre les problèmes civiques.

Ces initiatives visent à reprogrammer l’État, le rendre ouvert au retour d’expérience et éliminer tout autre moyen de faire de la politique. Pour toutes ces apps qui enregistrent notre comportement, ces algorithmes et ces capteurs pour travailler, nécessitent des bases de données interopérables – qui est ce que ces organisations pseudo-humanitaires demandent. Et quand le gouvernement est trop lent pour évoluer à la vitesse de la Silicon Valley, ils vont simplement s’installer à l’intérieur du gouvernement. Ainsi, Jennifer Pahlka, fondatrice du « Code for America » et protégée de O’Reilly, est devenue vice-directrice de la technologie du gouvernement des États-Unis – tout en bénéficiant d’une « bourse de l’innovation » d’un an de la Maison Blanche.

Les gouvernements à court d’argent accueillent favorablement cette colonisation par des technologues – surtout si elle permet d’identifier et nettoyer les ensembles de données qui peuvent être vendus avec profit à des entreprises qui ont besoin de ces données à des fins publicitaires. Les récents affrontements sur la vente de données sur les élèves et de la santé au Royaume-Uni sont juste un précurseur de batailles à venir : après tout les biens de l’État ont été privatisés, les données sont la prochaine cible. Pour O’Reilly, les données ouvertes sont « un élément clé de la révolution de la mesure ».

Cette « révolution de la mesure » vise à quantifier l’efficacité de divers programmes sociaux, comme si la raison d’être des filets de protection sociale que certains États fournissent était d’atteindre la perfection.

La raison réelle, bien sûr, était de permettre une vie épanouie en supprimant certaines angoisses, de sorte que les citoyens puissent poursuivre leur projet de vie relativement tranquillement. Cette vision porte sur un vaste appareil bureaucratique et les critiques de gauche de l’état providence – particulièrement celles de Michel Foucault – avaient raison de contester ses tendances « disciplinaires ». Quoi qu’il en soit, ni la perfection ni l’efficacité n’étaient le « résultat souhaité » de ce système. Ainsi, comparer l’état providence à l’état algorithmique pour de tels motifs est trompeur.

Mais nous pouvons comparer leur vision respective de l’épanouissement humain – et le rôle qu’ils accordent aux marchés et à l’État. L’offre de la Silicon Valley est claire : grâce aux retour d’expérience permanent, nous pouvons tous devenir des entrepreneurs et prendre soin de nos propres affaires ! Comme Brian Chesky, le chef de la direction de Airbnb, a dit au magazine The Atlantic l’an dernier, « Qu’est-ce qui se passe quand tout le monde est une marque ? Quand tout le monde a une réputation ? Chacun peut devenir un entrepreneur. »

En vertu de cette vision, nous allons tous coder (Pour l’Amérique !) le matin, conduire les voitures Uber dans l’après-midi, et louer nos cuisines comme restaurants – avec l’aimable autorisation de Airbnb – dans la soirée. Comme O’Reilly écrit de Uber et d’entreprises similaires, « ces services demandent à chaque passager d’évaluer leur pilote (et les conducteurs d’évaluer leur passager). Les pilotes qui fournissent un service médiocre sont éliminés. La réputation fait un meilleur travail pour offrir une expérience client superbe que tout effort de réglementation gouvernementale ».

L’État en arrière-plan de l’« économie de partage » ne se réduit pas significativement ; il pourrait même être nécessaire pour s’assurer que la réputation accumulée sur Uber, Airbnb et d’autres plates-formes de l’« économie de partage » soit totalement liquide et transférable, créant ainsi un monde où chacune de nos interactions sociales est enregistrée et évaluée, effaçant tout ce qui existe comme différences entre les secteurs de la société. Quelqu’un, quelque part, finira par vous évaluer en tant que passager, hôte de maison d’hôtes, étudiant, patient, client. Si cette infrastructure de classement centralisée ou distribuée, fournie par un géant comme Google ou appartenir à l’État, n’est pas encore claire, l’objectif principal est de faire de la réputation dans un réseau social, un moyen qui pourrait protéger les citoyens vraiment responsables des vicissitudes de la déréglementation.

Admirant les modèles de réputation de Uber et Airbnb, O’Reilly souhaite que les gouvernements « adoptent ceux qui ne montrent pas d’effets indésirables tangibles ». Mais ce qui compte comme « effet pernicieux » et comment le démontrer est une question clé. Il est facile de démontrer les « effets néfastes » si l’objectif de la réglementation est l’efficacité, mais si c’était autre chose ? Certes, il y a certains avantages – moins de visites chez le psychanalyste, peut-être – de ne pas voir toutes vos interactions sociales mesurées ?

L’impératif d’évaluer et de démontrer des « résultats » et des « effets » présuppose déjà que le but de la politique est l’optimisation de l’efficacité. Toutefois, tant que la démocratie est irréductible à une formule, ses valeurs seront toujours perdantes dans cette bataille car elles sont beaucoup plus difficiles à quantifier.

Pour la Silicon Valley, cependant, l’ »État algorithmique » obsédé par la réputation de l’économie de partage est le nouvel état providence. Si vous êtes honnête et travailleur, votre réputation en ligne le reflétera, produisant pour vous un filet social très personnalisé et « ultra-stable » au sens de Ashby.

Alors que l’état de bien-être suppose l’existence de maux sociaux spécifiques qu’il tente de combattre, l’état algorithmique ne fait pas de telles hypothèses. Les futures menaces peuvent rester totalement inconnaissables tout en étant entièrement adressables – sur le plan individuel. Silicon Valley, bien sûr, n’est pas le seul à vanter ces solutions individuelles ultra-stables. Nassim Taleb, dans son best-seller en 2012 Antifragile : les bienfaits du désordre, fait un plaidoyer semblable, plus philosophique, un plaidoyer pour maximiser notre ingéniosité individuelle et notre résilience : ne pas obtenir un emploi mais plusieurs, ne pas contracter de dette, compter sur notre propre expertise. Tout est question de prise de risque et de résilience et comme dit Taleb, « être sur la brèche ».

Comme Julian Reid et Brad Evans écrivent dans leur nouveau livre, « Resilient Life: The Art of Living Dangerously, » Vie résiliente : L’art de vivre dangereusement. Ce culte croissant de la résilience masque une reconnaissance tacite qu’aucun projet collectif ne pourrait même aspirer à apprivoiser les menaces multiples à l’existence humaine – nous ne pouvons qu’espérer nous armer à les aborder individuellement. « Quand les décideurs s’engagent dans le discours de la résilience », écrivent Reid et Evans, « ils le font en des termes qui visent explicitement à empêcher les humains de concevoir le danger comme un phénomène à partir duquel ils pourraient rechercher une libération et même, au contraire, comme ce à quoi ils doivent maintenant s’exposer. »

Quelle est donc l’alternative progressiste ? « L’ennemi de mon ennemi est mon ami » ne fonctionne pas ici simplement parce que si Silicon Valley attaque l’État-providence cela ne signifie pas que les progressistes doivent le défendre jusqu’à la dernière balle (ou le dernier tweet). Tout d’abord, même les gouvernements de gauche ont un espace limité pour les manœuvres fiscales, parce que le type de dépenses discrétionnaires nécessaires à la modernisation de l’État-providence ne sera jamais approuvé par les marchés financiers mondiaux. Et ce sont les agences de notation et les marchés obligataires – et non pas les électeurs – qui sont en charge aujourd’hui.

Deuxièmement, la critique de gauche de l’État-providence est devenue d’autant plus pertinente aujourd’hui alors que les frontières exactes entre bien-être et sécurité sont devenues si floues.

Lorsque les Android de Google animeront massivement notre vie quotidienne, la tentation du gouvernement de nous gouverner par voitures télécommandées et distributeurs de savon alarme sera devenue considérable. Cela permettra d’élargir l’emprise des gouvernements sur les domaines de la vie auparavant exempts de réglementation.

Avec autant de données, l’argument favori du gouvernement dans la lutte contre le terrorisme – si seulement les citoyens en savaient autant que nous, eux aussi imposeraient toutes ces entorses à la loi – s’étend facilement à d’autres domaines, allant de la santé au changement climatique. Ainsi une publication académique récente qui a utilisé les données de recherche Google pour étudier des modèles d’obésité aux États-Unis, a trouvé une corrélation significative entre les mots clé de recherche et les niveaux de l’indice de masse corporelle. « Les résultats sont très prometteurs dans le sens d’une surveillance de l’obésité en temps réel par des données fournies par Google Trends », notent les auteurs, qui seraient « particulièrement intéressantes pour les établissements de santé publics et les entreprises privées telles que les compagnies d’assurance. »

Si Google détecte une épidémie de grippe, quelque part, il est difficile de contester son information – nous n’avons tout simplement pas l’infrastructure nécessaire pour traiter autant de données à cette échelle. Mais Google peut se tromper – comme cela a été le cas récemment avec ses données sur les tendances de la grippe, il a en effet surestimé le nombre d’infections, probablement en raison de son incapacité à tenir compte de la forte médiatisation de la grippe – ce qui est aussi le cas avec la plupart des alertes terroristes. C’est l’immédiat, la nature en temps réel des systèmes informatiques qui en fait les parfaits alliés d’un état obsédé par la prévention.

Peut-être, le cas de Gloria Placente et son voyage raté à la plage n’était pas seulement une curiosité historique, mais un présage de la façon dont l’informatique en temps réel, combinée à des technologies de communication omniprésentes, pourrait transformer l’État. Une des rares personnes à avoir pris en compte ce présage était un dirigeant d’agence de publicité américain peu connu appelé Robert MacBride. Celui-ci a poussé la logique derrière l’opération CORRAL à ses conséquences ultimes dans son livre de 1967 injustement négligé, « L’État automatisé « . The Automated State.

À l’époque, l’Amérique était en train de débattre du bien-fondé de la création d’un centre national de données pour agréger différentes statistiques nationales et les rendre disponibles à des organismes gouvernementaux. MacBride a critiqué l’incapacité de ses contemporains à voir comment l’État pourrait exploiter les métadonnées quand tout serait en passe d’être informatisé. Au lieu d’un « Empire austro-hongrois à grande échelle », les systèmes informatiques modernes produiraient « une bureaucratie d’une efficacité pratiquement céleste » qui peut « identifier et définir les relations d’une manière que nulle bureaucratie humaine ne pourrait jamais espérer mettre en place ».

« Que l’on joue au bowling un dimanche ou qu’on visite une bibliothèque est sans conséquence puisque personne ne va le vérifier », écrivait-il. Mais ce n’est pas le cas lorsque les systèmes informatiques peuvent agréger des données provenant de différents domaines et les corréler sur place. « Notre comportement individuel dans l’achat et la vente d’une automobile, une maison, ou d’un titre, à payer nos dettes et en acquérir de nouvelles, et gagner de l’argent et être payé, sera noté méticuleusement étudié de manière exhaustive », a prévenu MacBride.

Ainsi, un citoyen va bientôt découvrir que « le choix de ses abonnements à des magazines … peut être trouvé et indiquer avec précision la probabilité d’entretenir sa propriété ou son intérêt pour l’éducation de ses enfants. » Cela sonne étrangement similaire à la récente affaire d’un père malheureux qui a constaté que sa fille était enceinte par le biais d’un coupon ciblé, qu’un détaillant avait envoyé à leur maison. Le choix de la cible a été basé sur l’analyse des produits – par exemple, « lotion non parfumée – le plus souvent acheté par d’autres femmes enceintes « .

Pour MacBride la conclusion était évidente. « Les droits politiques ne seront pas violés mais ils ressembleront à ceux d’un petit actionnaire dans une entreprise géante », écrit-il. « La marque de sophistication et de savoir-faire dans cet avenir sera la grâce et la souplesse avec laquelle on accepte son rôle et fait le maximum de ce qu’il offre. » En d’autres termes, puisque nous sommes en premier lieu tous des entrepreneurs, et seulement en second lieu des citoyens, autant se faire une raison et en tirer le meilleur.

Alors, que faut-il faire ? La techno-phobie n’est pas la solution. Les progressistes ont besoin de technologies qui collent à l’esprit – si ce n’est pas à la forme institutionnelle – de l’état providence, la préservation de l’engagement à créer des conditions idéales pour l’épanouissement de l’homme. Même une certaine « ultra stabilité » pourrait être la bienvenue. La stabilité était un objectif louable de l’état providence avant d’avoir rencontré un piège : en spécifiant les mesures de protection précises que l’État se devait d’offrir contre les excès du capitalisme, l’empêchait de réagir facilement et rapidement à de nouvelles formes non précisées de l’exploitation.

Alors, que faut-il faire ? La techno-phobie n’est pas la solution. Les progressistes ont besoin de technologies qui collent à l’esprit – si ce n’est pas à la forme institutionnelle – de l’état providence, la préservation de l’engagement à créer des conditions idéales pour l’épanouissement de l’homme. Même une certaine « ultra stabilité » pourrait être la bienvenue. La stabilité était un objectif louable de l’état providence avant d’avoir rencontré un piège : en spécifiant les mesures de protection précises que l’État se devait d’offrir contre les excès du capitalisme, l’empêchait de réagir facilement et rapidement à de nouvelles formes non précisées de l’exploitation.

Comment construire un soutien social qui soit à la fois décentralisée et ultra-stable ? Une forme de revenu de base garanti – où certains services sociaux sont remplacés par des transferts directs en espèces aux citoyens – s’adapte aux deux critères.

Créer les conditions pour l’émergence de communautés politiques autour des enjeux et des questions qu’elles jugent pertinentes serait une autre étape souhaitable. Le plein respect du principe de l’ultra-stabilité dicte que ces questions ne puissent ni être anticipées ni dictées d’en-haut – par les partis politiques ou les syndicats – et doivent être laissées non précisées.

Quel est le type d’infrastructure de communication qu’il faille mettre en œuvre ? Elle devrait être gratuite, difficile à espionner, et ouverte à de nouveaux usages, des usages subversifs. L’infrastructure existante de la Silicon Valley est idéale pour répondre aux besoins de l’État, pas pour ceux des citoyens souhaitant s’auto-organiser. Elle peut, bien sûr, être redéployée pour des causes militantes – et elle l’est souvent – mais il n’y a aucune raison d’accepter le statu quo comme idéal ou inévitable.

Pourquoi, après tout, confisquer ce qui devrait appartenir au peuple de toute manière ? Alors que la plupart des créateurs de l’Internet déplorent la façon dont leur créature est tombée aussi bas, leur colère est mal orientée. La faute n’est pas à cette entité amorphe mais, tout d’abord, à l’absence d’une politique de gauche en matière de technologie – une politique qui puisse contrer l’agenda pro-innovation, pro-privatisation de la Silicon Valley. En son absence, toutes les contre-communautés de gauche sont manchotes. Le prochain « Occupy Wall Street » serait-il en mesure d’occuper une ville vraiment « intelligente » ? Cela reste à voir : ce qui est le plus probable, c’est qu’il serait sur-réprimé et sur-droné.

Il faut dire au crédit de MacBride, qu’il avait tout compris en 1967 : « Compte tenu des ressources technologiques et techniques de planification modernes », a-t-il averti, « ce n’est vraiment pas très compliqué de transformer même un pays comme le nôtre en une entreprise où le bon fonctionnement de tous les détails de la vie est une fonction mécanique prise en charge ».

La crainte de MacBride est devenue le plan directeur de O’Reilly : « le gouvernement, écrit-il, devrait être calqué sur l’approche « lean startup » (startup svelte) de la Silicon Valley, qui « en utilisant les données produites révise constamment et affine son approche du marché ». C’est cette approche que Facebook a récemment déployée afin de maximiser la participation des utilisateurs sur le site : si le truc c’est de montrer aux utilisateurs des histoires qui se terminent mieux, ainsi soit-il.

La réglementation algorithmique, quelles que soient ses avantages immédiats, produira un régime politique où les entreprises de technologie et les bureaucrates du gouvernement décident de tout. L’auteur polonais de science-fiction Stanislaw Lem, dans une critique bien vue de la cybernétique, publiée à peu près au même moment que l’État automatisé, écrivait : « La société ne peut pas se débarrasser du fardeau d’avoir à décider de son propre sort en sacrifiant cette liberté au bénéfice du régulateur cybernétique ».

Evgeny Morozov –« La prise de pouvoir des données et la mort de la politique », publié dans The Observer, le 20 juillet 2014.

Merci à Paul Jorion pour son autorisation de relai dans UP’ Magazine

(Merci à Guy Weets pour la traduction. © The Guardian)